LLama实战本地CPU推理大语言模型-C++开发实战

LLama实战本地CPU推理大语言模型-C++开发实战

LLama实战本地CPU推理大语言模型-C++开发实战

网盘截图:

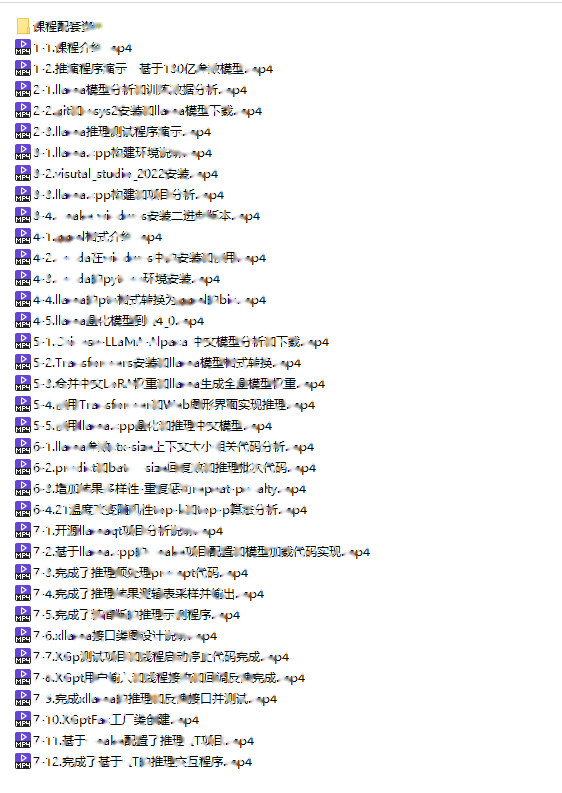

课程目录:

│ 1-1.课程介绍.mp4

│ 1-2.推演程序演示,基于130亿参数模型.mp4

│ 2-1.llama模型分析和训练数据分析.mp4

│ 2-2.git和msys2安装和llama模型下载.mp4

│ 2-3.llama推理测试程序演示.mp4

│ 3-1.llama.cpp构建环境说明.mp4

│ 3-2.visutal_studio_2022安装.mp4

│ 3-3.llama.cpp构建和项目分析.mp4

│ 3-4.cmake windows安装二进制版本.mp4

│ 4-1.ggml格式介绍.mp4

│ 4-2.conda在windows中的安装和使用.mp4

│ 4-3.conda的python环境安装.mp4

│ 4-4.llama的pth格式转换为ggml的bin.mp4

│ 4-5.llama量化模型到Q4_0.mp4

│ 5-1.Chinese-LLaMA-Alpaca 中文模型分析和下载.mp4

│ 5-2.Transformers安装和llama模型格式转换.mp4

│ 5-3.合并中文LoRA权重和llama生成全量模型权重.mp4

│ 5-4.使用Transformer和Web图形界面实现推理.mp4

│ 5-5.使用llama.cpp量化和推理中文模型.mp4

│ 6-1.llama参数ctx-size上下文大小相关代码分析.mp4

│ 6-2.predict和batch-size回复数和推理批次代码.mp4

│ 6-3.增加结果多样性-重复惩罚repeat-penalty.mp4

│ 6-4.21温度改变随机性top-k和top-p算法分析.mp4

│ 7-1.开源llamaqt项目分析说明.mp4

│ 7-10.XGptFac工厂类创建.mp4

│ 7-11.基于cmake配置了推理QT项目.mp4

│ 7-12.完成了基于QT的推理交互程序.mp4

│ 7-2.基于llama.cpp的cmake项目配置和模型加载代码实现.mp4

│ 7-3.完成了推理预处理prompt代码.mp4

│ 7-4.完成了推理结果逻辑表采样并输出.mp4

│ 7-5.完成了精简版的推理示例程序.mp4

│ 7-6.xllama接口类图设计说明.mp4

│ 7-7.XGp测试项目和线程启动停止代码完成.mp4

│ 7-8.XGpt用户输入和线程接收和回调反馈完成.mp4

│ 7-9.完成xllama的推理和反馈接口并测试.mp4

│

└─课程配套资料免责声明: 1、本站信息来自网络,版权争议与本站无关 2、本站所有主题由该帖子作者发表,该帖子作者与本站享有帖子相关版权 3、其他单位或个人使用、转载或引用本文时必须同时征得该帖子作者和本站的同意 4、本帖部分内容转载自其它媒体,但并不代表本站赞同其观点和对其真实性负责 5、用户所发布的一切软件的解密分析文章仅限用于学习和研究目的;不得将上述内容用于商业或者非法用途,否则,一切后果请用户自负。 6、您必须在下载后的24个小时之内,从您的电脑中彻底删除上述内容。 7、请支持正版软件、得到更好的正版服务。 8、如有侵权请立即告知本站(邮箱:204942507@qq.com),本站将及时予与删除 9、本站所发布的一切破解补丁、注册机和注册信息及软件的解密分析文章和视频仅限用于学习和研究目的;不得将上述内容用于商业或者非法用途,否则,一切后果请用户自负。本站信息来自网络,版权争议与本站无关。您必须在下载后的24个小时之内,从您的电脑中彻底删除上述内容。如果您喜欢该程序,请支持正版软件,购买注册,得到更好的正版服务。如有侵权请邮件与我们联系处理。

小麻雀IT分享站 » LLama实战本地CPU推理大语言模型-C++开发实战

小麻雀IT分享站 » LLama实战本地CPU推理大语言模型-C++开发实战

常见问题FAQ

- 视频格式是什么?

- 不加密,网盘在线学习

- 怎么发货?

- 有些资源没更新完结怎么办?

- 有问题不懂的怎么办?